Группа исследователей разработала план создания алгоритмов искусственного интеллекта, которые способны учитывать этические нормы при принятии решений. Проект был создан для таких технологий взаимодействия человека и искусственного интеллекта, как боты-помощники в медицинских учреждениях. Статья с исследованием опубликована в журнале AI and Ethics.

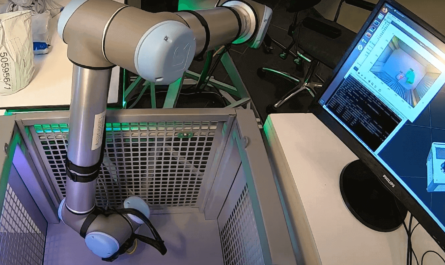

Боты-помощники в уходе за больными будут способны создавать комфортные и безопасные условия для пациентов, пожилых людей, которым требуется контроль за состоянием здоровья или физическая помощь. Новая технология будет использоваться в ситуациях, при которых ботам-помощникам придётся принять этический выбор.

Например, робот-помощник находится в ситуации, когда два человека нуждаются в медицинской помощи. Один пациент находится без сознания, а второй пациент требует, чтобы робот-помощник оказал ему первую помощь. Как бот решает, какому пациенту оказать первую помощь? Должен ли робот-помощник лечить пациента, находящегося без сознания и, следовательно, неспособного дать согласие на лечение?

Чтобы справиться со сложностью принятия моральных решений, исследователи разработали алгоритм и набор решений, которые можно включить в программу обучения искусственного интеллекта. Формула основана на так называемой модели «Исполнитель, действие и последствия», отражающей то, как люди делают сложный моральный выбор в реальном мире.