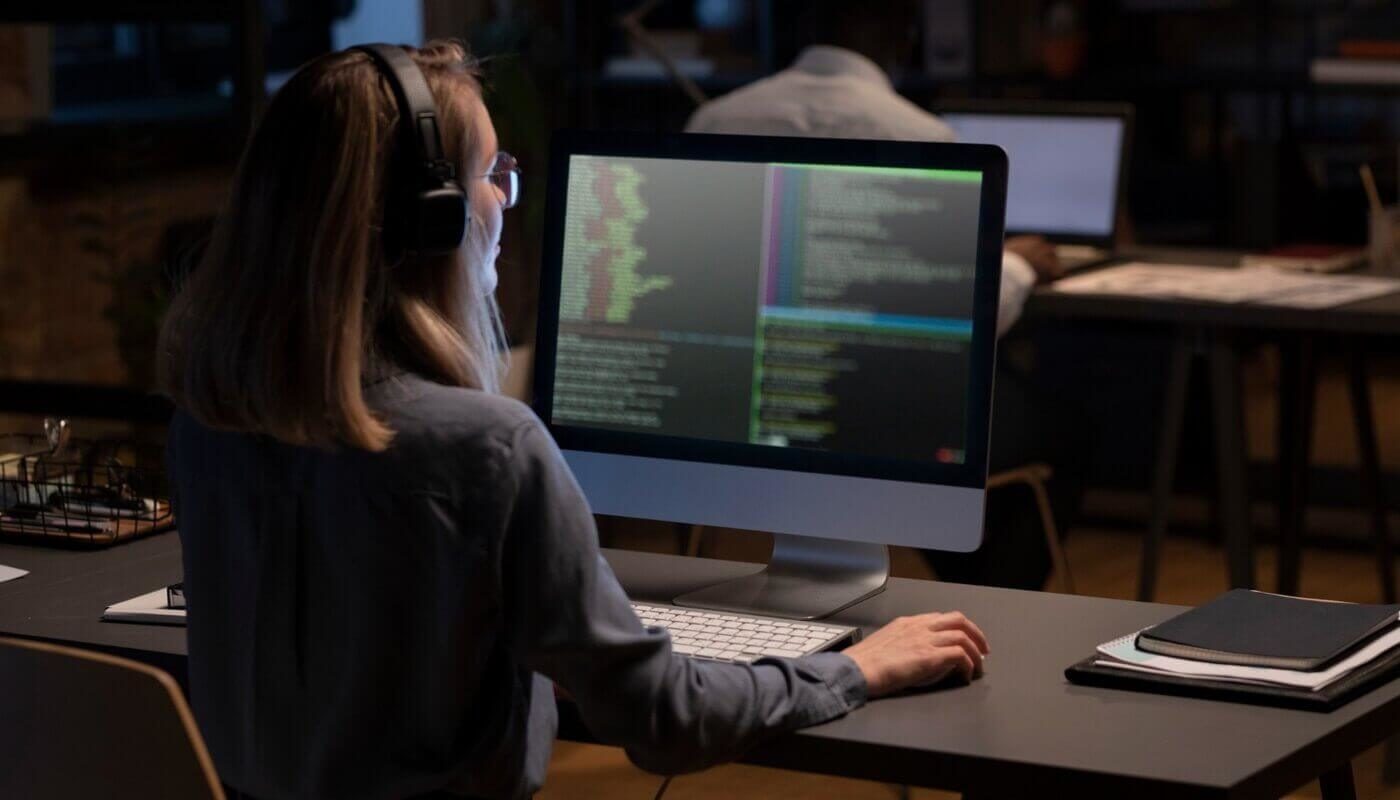

Чтобы большая языковая модель отвечала качественно и быстро, требуется множество дорогостоящих мощных графических процессоров. Российские исследователи разработали и опубликовали в свободном доступе новые методы сжатия больших языковых моделей. Они позволяют бизнесу сократить расходы на вычислительные ресурсы до восьми раз. Решение полезно корпорациям, стартапам и исследователям, которые запускают нейросети на своём оборудовании. Научная статья о методе сжатия AQLM опубликована на arXiv.

Новое решение позволяет уменьшить модель в несколько раз. Это сокращает количество необходимых для работы процессоров и позволяет запустить её на устройствах с меньшей вычислительной мощностью. То есть делает внедрение нейросетей и обслуживание оборудования дешевле для бизнеса. При использовании других методов сжатия значительно теряется качество ответов нейросети. Новый метод решает эту проблему и включает два инструмента. Первый позволяет получить уменьшенную до восьми раз нейросеть, которая быстрее работает и может быть запущена, например, на одном графическом процессоре вместо четырёх. Второй инструмент исправляет ошибки, которые возникают в процессе сжатия большой языковой модели.

Эффективность методов сжатия нейросетей оценивали на популярных моделях с открытым исходным кодом: Llama 2, Llama 3, Mistral и других. Качество ответов оригинальной и сжатой версии нейросети сравнивали на англоязычных бенчмарках — тестах, которые состоят из наборов вопросов из разных областей знаний. Новый подход показал лучший результат среди всех существующих методов сжатия. Он сохраняет в среднем 95% качества ответов нейросети. Для сравнения, другие популярные инструменты сохраняют для тех же моделей от 59% до 90% качества. Новые методы сжатия нейросетей уже доступны для применения — код опубликован на GitHub. Специалисты также могут скачать по ссылке уже сжатые с помощью новых методов популярные модели с открытым исходным кодом. Кроме того, исследователи выложили обучающие материалы, которые помогут разработчикам дообучить уменьшенные нейросети под свои сценарии.