Исследователи из лаборатории искусственного интеллекта Netease Fuxi и Университета Мичигана разработали технологию MeInGame, которая самостоятельно генерирует лица путём анализа отдельного портрета. Код MeInGame выложен на GitHub.

Чтобы точно воспроизводить черты лица человека, трёхмерные модели морфинга должны учиться на огромном количестве текстурных данных и изображениях.

Соединение в целое таких данных, как правило, занимает много времени. Плюс этой системе необходимо регулярно загружать новые данные для стабильной работы. Для обхода этого ограничения авторы изобретения используют не искусственно созданные изображения, а фотографии настоящих людей.

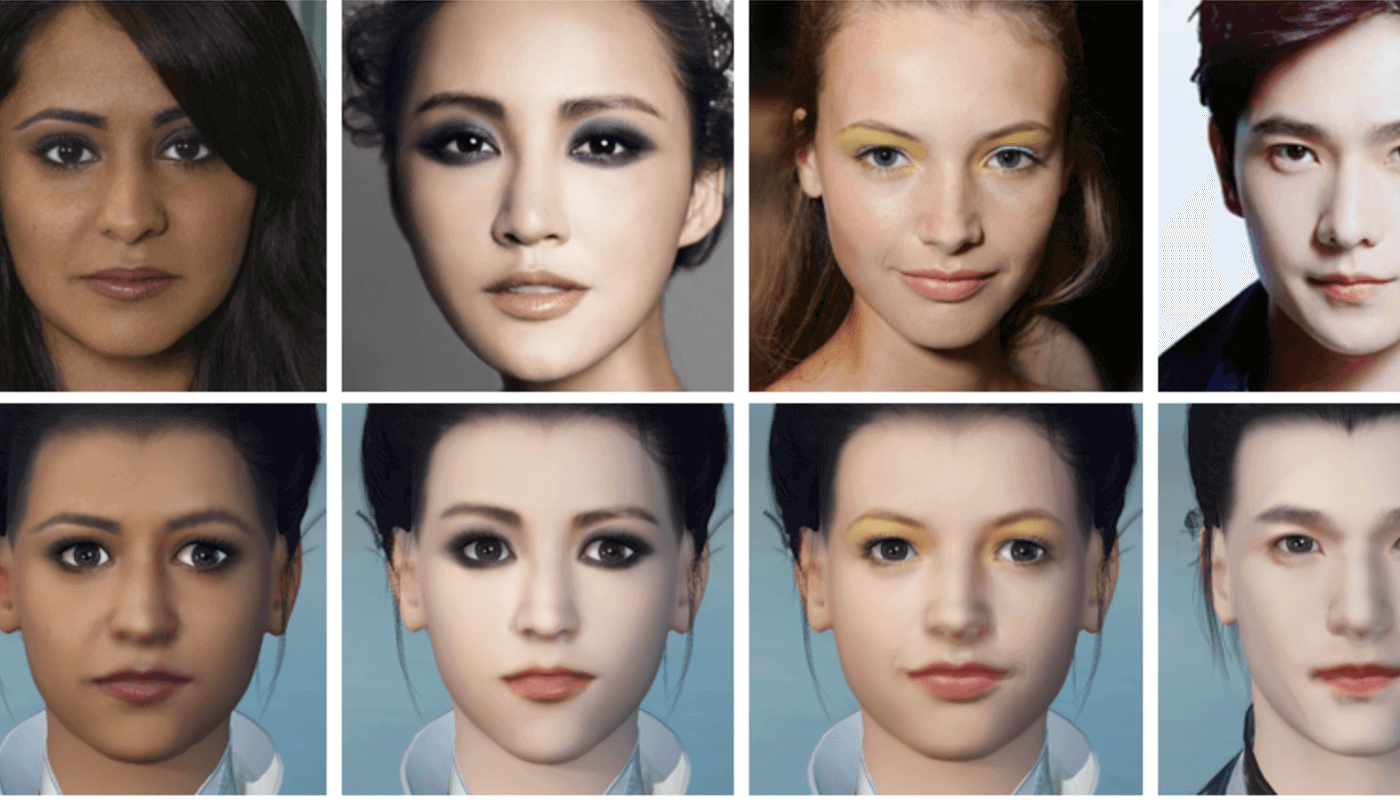

«Предлагаемый метод позволяет не только создавать детализированных и ярких игровых персонажей, похожих на исходный портрет, но также устранять влияние освещения и затемнений. Эксперименты показывают, что наш метод превосходит современные методы, используемые в играх», — комментируют исследователи.

Сперва они воссоздавали лицо исходя из 3D-морфируемой модели и свёрточных нейронных сетей. Потом перемещали форму объёмного лица на сетку шаблонов. В итоге сеть принимает изображение лица и развёрнутую проекцию всех поверхностей 3D-модели на плоскость в качестве исходных данных. После чего сеть составляет прогноз коэффициентов освещения.

Изобретатели тестировали свой метод глубокого обучения в ряде экспериментов: они сопоставляли качество игровых образов с прочими сгенерированными моделями.