Искусственный интеллект (ИИ) способен принести много пользы людям. А может ли он работать против нас? К примеру, общественный резонанс вызвала история с китайской технологической компанией Health Boost IoT Technology, которая использовала «умные» подушки для офисных стульев со встроенными датчиками. Помимо пульса и осанки сотрудников, «умная» подушка фиксировала количество минут, проведённых на рабочих местах. В какой-то момент сотрудники сообразили — подушки следили за их передвижениями в течение дня.

В Великобритании неправильный алгоритм занижал оценки выпускников школ с низким рейтингом. Абитуриенты из бедных семей лишились возможности поступить в ведущие вузы страны. По стране прокатилась волна демонстраций, на которых протестующие скандировали: «К чёрту алгоритм!». Результаты экзаменов были отменены.

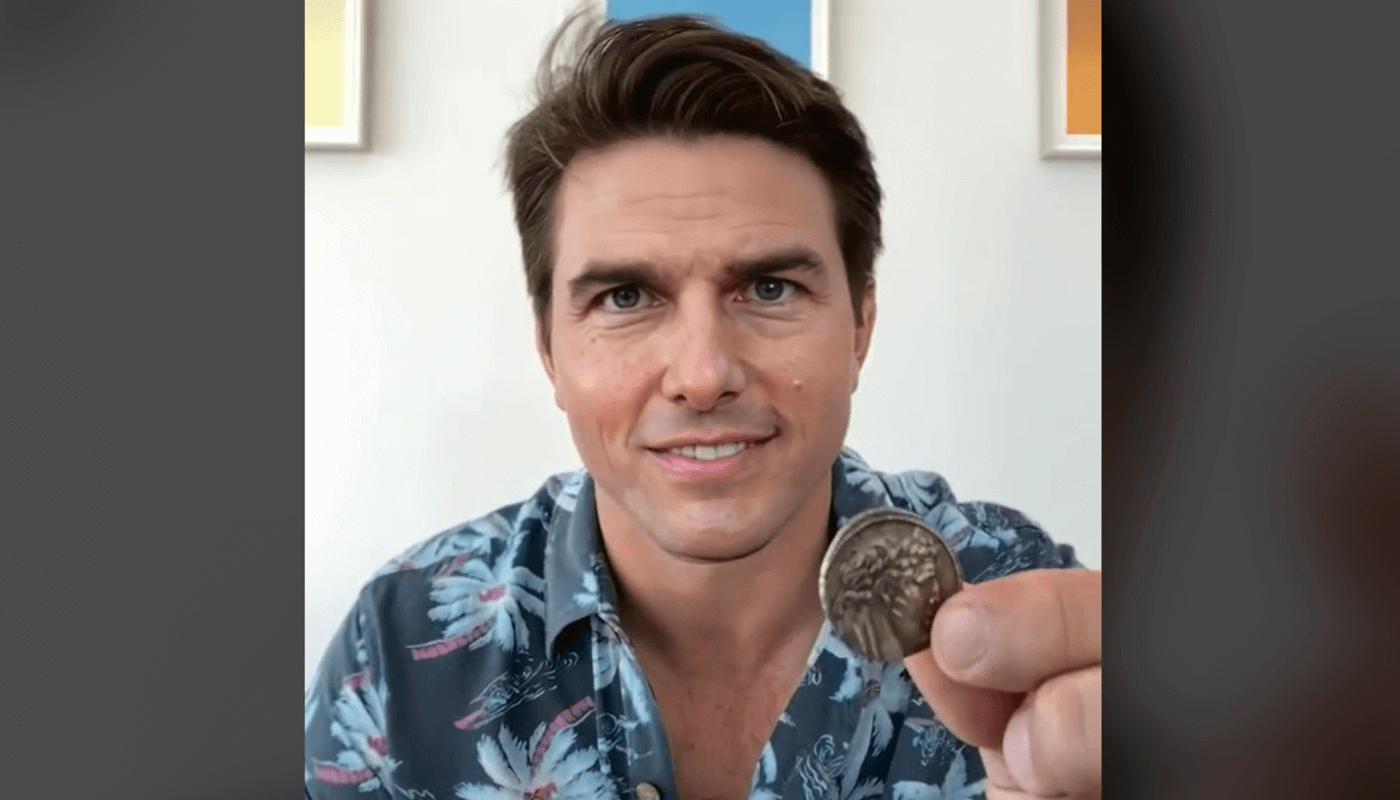

Всё более реалистичными становятся дипфейки. При этом технология развивается быстрее, чем законы, позволяющие её регулировать.

По оценкам экспертов, ущерб от мошеннических афер с дипфейками в 2020 году превысил 250 миллионов долларов США. В Индии мошенники с помощью этой технологии вымогали деньги после откровенных видеозвонков в соцсетях. Многие жертвы впадали в депрессию, а некоторые проявляли суицидальные наклонности.

Группа энтузиастов в сети собирает информацию о злоупотреблениях технологиями искусственного интеллекта, несправедливости и предвзятости созданных программ, которые:

- выявляют по лицу генетические болезни, уровень интеллекта или склонность к совершению преступлений;

- создают базу данных распознавания лиц людей, сканируя их профили в социальных сетях;

- производят фейковые новости. Те, в свою очередь, используются для манипулирования фондовыми рынками и общественным мнением;

- сканируют голосовые данные и видеоинтервью кандидатов, распознают ложь и настроение человека по выражению лица и интонации;

- принимают решение об увольнении сотрудника. Алгоритм отслеживает продуктивность и контролирует каждый шаг работника, часто не учитывая человеческий фактор.

Непрозрачность инструментов искусственного интеллекта

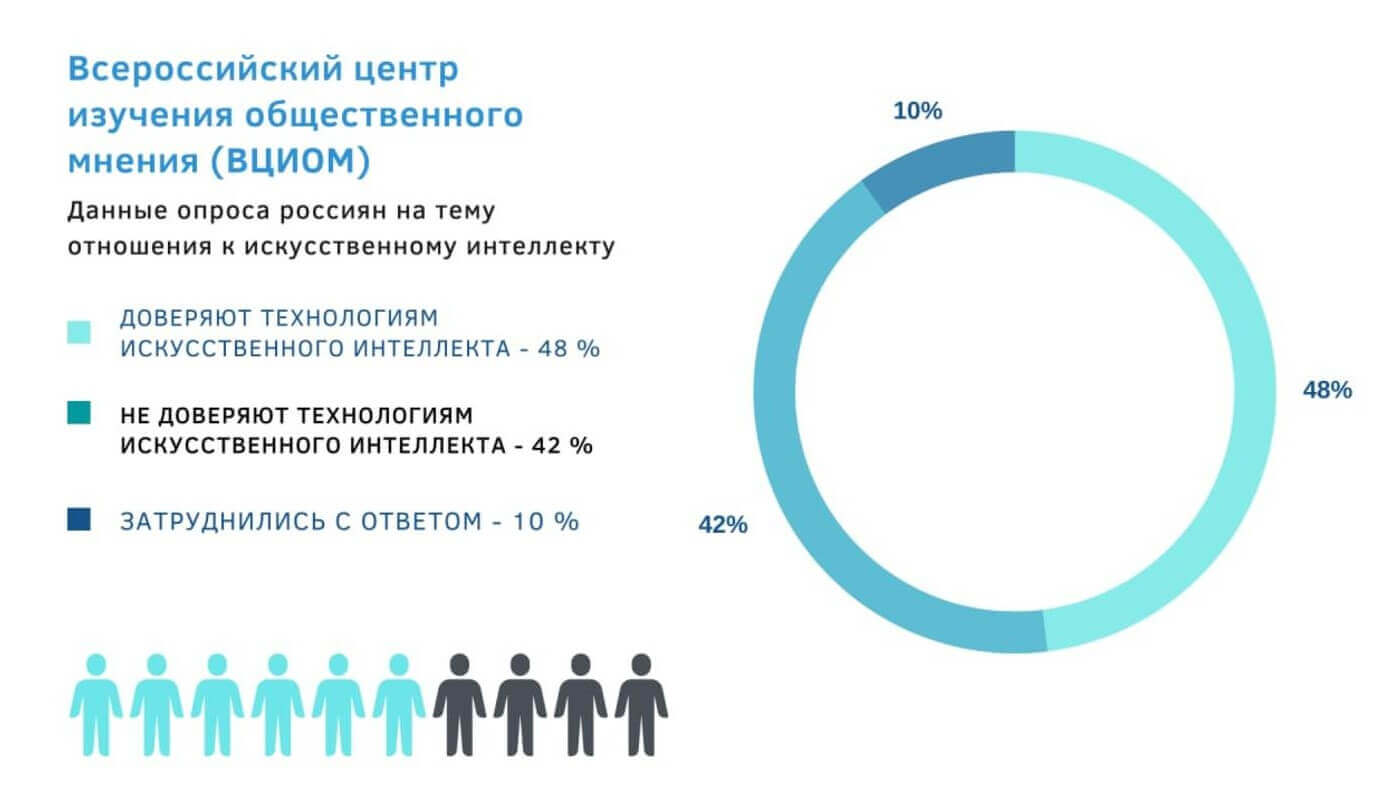

По данным недавнего опроса ВЦИОМ, 42% россиян не доверяют технологиям искусственного интеллекта. Причин может быть много, но некоторые из них — объяснимы.

Решения ИИ не всегда понятны людям. Они не получают чётких ответов на свои вопросы, а компании не делятся информацией: как программа принимает решение, какие у неё сильные и слабые стороны, кто обучает системы искусственного интеллекта, на чём основаны рекомендации алгоритмов. «Объяснимый искусственный интеллект» повышает достоверность и надёжность результатов, а отсутствие доступной и понятной информации — вызывает недоверие, порождает новые вопросы, в том числе, у самих разработчиков.

Предвзятость искусственного интеллекта

Результат, к которому приходит ИИ, нельзя назвать нейтральным. Его решения подвержены неточностям и предубеждениям, которые связаны с человеческим фактором.

Три звена в цепочке формирования предвзятости:

- Разработчики, которые создают системы глубинного обучения, имеют свой жизненный опыт и, как все люди, подвержены стереотипам, поэтому не могут обладать абсолютной объективностью.

- Они переносят свои предубеждения в системы, которые разрабатывают. Так появляется алгоритмическая предвзятость.

- В работе системы искусственного интеллекта демонстрируют различные проявления гендерного, экономического и расового неравенства. Они приобретаются, в том числе, в процессе самообучения.

Хорошие новости заключаются в том, что ИИ находится под контролем человека. Именно люди закладывают в него те или иные ценности и нормы. Поэтому так важно, чтобы у искусственного интеллекта была обширная выборка данных для обучения. А у человека — ответственный подход к разработке ИИ.

Систематические нарушения неприкосновенности частной жизни

Искусственный интеллект уже присутствует в нашей жизни. Он изучает наши интересы и анализирует наш выбор. Мы встречаемся с ним в транспорте, в банках, в магазинах, на работе и в быту. И взаимодействие с высокими технологиями вызывает множество вопросов как с юридической, так и с этической стороны. Как регулировать взаимодействие человека и искусственного интеллекта в вопросах, связанных с искусством, правосудием, медициной, образованием, военной сферой? Технологии ИИ развиваются. Вопросов будет больше, а этические проблемы будут становиться всё серьезнее и сложнее.

«Люди всё больше и больше будут доверять искусственному интеллекту, передавать свои знания и умения алгоритмам. В принципе уже сегодня миллиарды пользователей считают, что Facebook лучше них выстроит их собственную картину дня, Google подскажет, правдива ли та или иная информация, Netflix выберет фильм для просмотра, а Amazon и Alibaba посоветуют следующую покупку. Те же алгоритмы в недалёком будущем теоретически легко могут предсказать за человека, куда ему идти работать и с кем заводить брак, а компаниям и банкам — кого нанимать на работу и кому одалживать», — говорит Юваль Ной Харари, профессор исторического факультета Еврейского университета в Иерусалиме, автор международного бестселлера «Sapiens: Краткая история человечества».

Как контролировать искусственный интеллект?

Размышления о том, что разумные машины восстанут и захотят захватить мир — пока оставим футурологам и писателям. Но то, что новейшие технологии оказывают серьезное влияние на нашу жизнь уже сейчас и требуют строгого контроля — этот факт признан мировым сообществом. Многие страны разрабатывают различные нормативные акты, задачи которых — защитить права и интересы человека.

Развитие искусственного интеллекта носит глобальный характер, поэтому ЮНЕСКО выступила с предложением разработать глобальный нормативный акт, который поможет людям в вопросе этичного использования искусственного интеллекта по всему миру. Организация проводила консультации с ведущими экспертами по цифровым технологиям из 155 стран мира, были приглашены крупнейшие компании в отрасли: Google, Facebook, Microsoft. Документ планируют представить на Генеральной конференции ЮНЕСКО в ноябре 2021 года.

Какие нормативные акты по этике ИИ существуют в России?

Альянс в сфере искусственного интеллекта (Mail.ru Group, «Газпром нефть», МТС, «Сбер», «Яндекс» и Российский фонд прямых инвестиций, при участии представителей научного сообщества) объявил о разработке проекта Национального кодекса этики. Это первый документ подобного рода в России. Если компания, которая использует ИИ в своей работе, нарушает рекомендации Кодекса, то её ждёт общественное порицание. Это может серьезно сказаться на репутации. Планируется утвердить Кодекс в октябре 2021 на Форуме по этике в сфере искусственного интеллекта.

Возможно, нам пока не стоит беспокоиться о том, на что машины способны сегодня. Но мы мчимся на большой скорости по незнакомой трассе, и у нас — нет водителя за рулём. А вдруг что-то пойдёт не так? Люди должны быть готовы к встрече с сильным искусственным интеллектом, тогда самые фантастические мечты человека станут реальностью.