Для создания наиболее продвинутых форм дипфейков используются GAN-модели. Так разработчики нейросетей называют особый класс «творческих» систем искусственного интеллекта, состоящие из двух половин, одна из которых генерирует фейковые изображения, а вторая — оценивает разницу между фейком и оригиналом. Это позволяет создавать изображения, неотличимые от настоящих. Немецкие исследователи создали алгоритм обработки изображений, который делает их бесполезными в качестве основы для дипфейков: фото-, аудио- и видеоконтента, модифицированного с помощью искусственного интеллекта. Новый алгоритм называется UnGANable. Исследование опубликовано по ссылке.

Одной из ключевых фаз в работе этих GAN-моделей является процедура обращения, при которой изображения преобразуются в математические векторы. Она позволяет извлекать характерные черты лица человека на изображении, добавлять их в многообразие всех известных алгоритму черт и вносить произвольные изменения. Так, в частности, можно добавить улыбку человеку на снимке, искусственно состарить его или изменить цвет его волос. Учёные обнаружили, что процедуру обращения можно серьёзно затруднить, если создать на уровне математических векторов «шум» — невидимые многочисленные изменения. Это помешает системе генерации дипфейков получить данные и использовать их для манипуляции чертами лица.

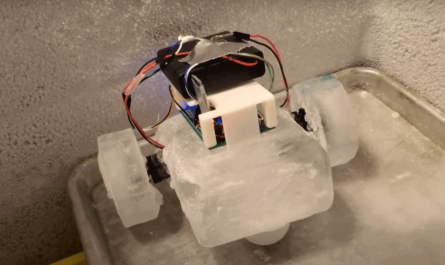

Работу этого подхода исследователи проверили на пяти системах создания дипфейков, в том числе нейросети StyleGAN2, которую часто применяют для создания фейковых фотографий и видеороликов знаменитостей. Обработка подобных снимков при помощи нового алгоритма привела к появлению легко заметных артефактов и искажений при подготовке дипфейков всеми пятью GAN-сетями. В этом отношении, как отмечают учёные, созданный подход превзошёл другие системы защиты от дипфейков. Аналогичным образом можно создать алгоритм, который будет защищать от подделок не только фотографии, но и видеофайлы.